当爬虫偷偷抓取你的云服务器上的应用时,你知道吗?

发布时间:2019-03-19 13:22:20编辑:丝画阁阅读(178)

概述

最近阿里云经常会被各种爬虫光顾,有的是搜索引擎爬虫,有的不是,通常情况下这些爬虫都有UserAgent,而我们知道UserAgent是可以伪装的,UserAgent的本质是Http请求头中的一个选项设置,通过编程的方式可以给请求设置任意的UserAgent。

下面的Linux命令可以让你清楚的知道蜘蛛的爬行情况。我们针对nginx服务器进行分析,日志文件所在目录:/usr/local/nginx/logs/access.log,access.log这个文件记录的应该是最近一天的日志情况,首先请看看日志大小,如果很大(超过50MB)建议别用这些命令分析,因为这些命令很消耗CPU,或者更新下来放到分析机上执行,以免影响服务器性能。

常用蜘蛛的域名

常用蜘蛛的域名都和搜索引擎官网的域名相关,例如:

- 百度的蜘蛛通常是baidu.com或者baidu.jp的子域名

- google爬虫通常是googlebot.com的子域名

- 微软bing搜索引擎爬虫是search.msn.com的子域名

- 搜狗蜘蛛是crawl.sogou.com的子域名

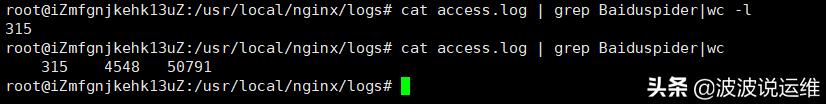

1、计算百度蜘蛛爬行的次数

cat access.log | grep Baiduspider | wc

最左面的数值显示的就是爬行次数。

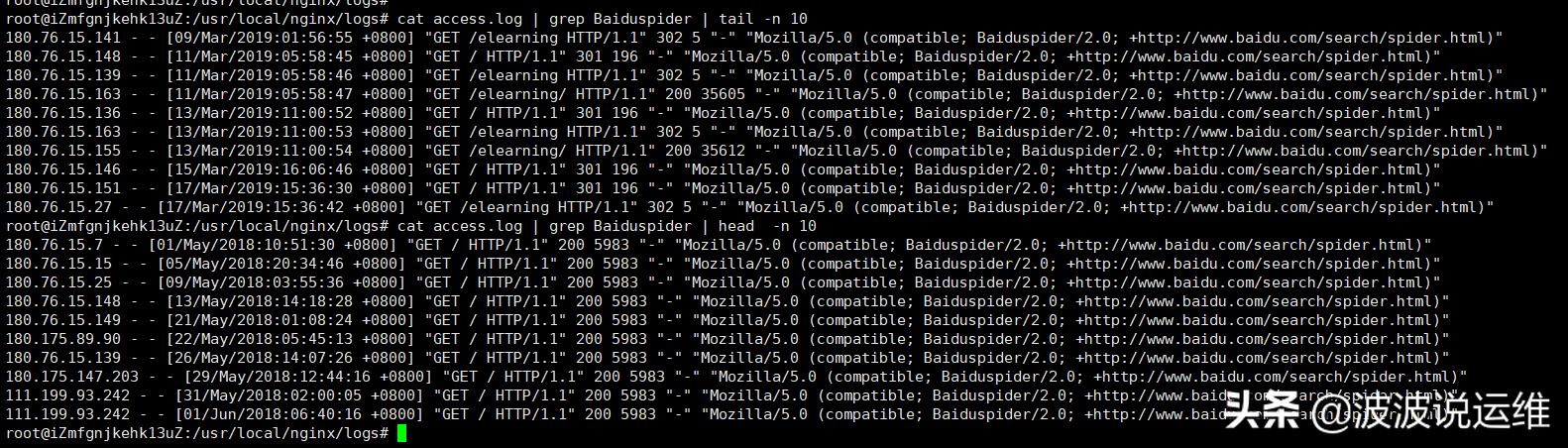

2、百度蜘蛛的详细记录(Ctrl C可以终止)

cat access.log | grep Baiduspider

也可以用下面的命令:

cat access.log | grep Baiduspider | tail -n 10

cat access.log | grep Baiduspider | head -n 10

说明:只看最后10条或最前10条

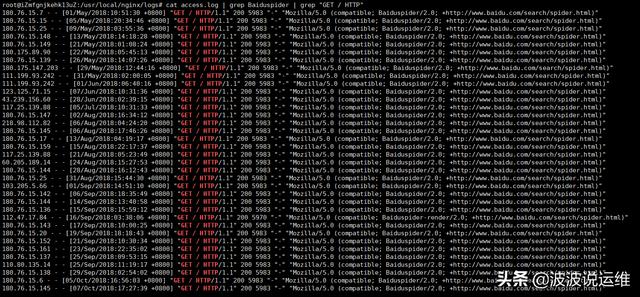

3、百度蜘蛛抓取首页的详细记录

cat access.log | grep Baiduspider | grep “GET / HTTP”

百度蜘蛛好像对首页非常热爱每个钟头都来光顾,而谷歌和雅虎蜘蛛更喜欢内页。

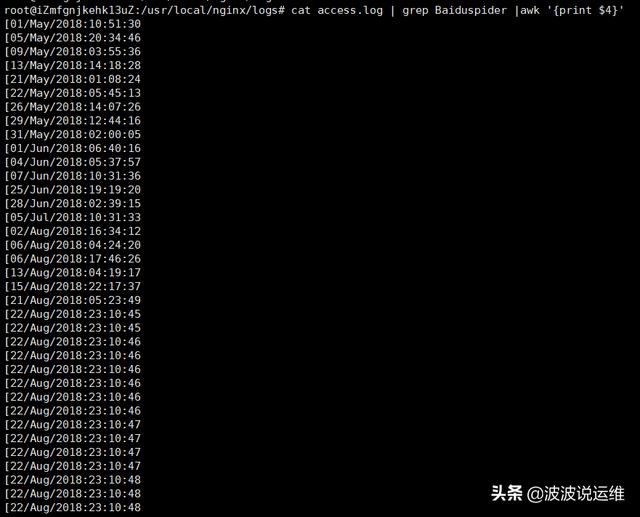

4、百度蜘蛛派性记录时间点分布

cat access.log | grep “Baiduspider ” | awk ‘{print $4}'

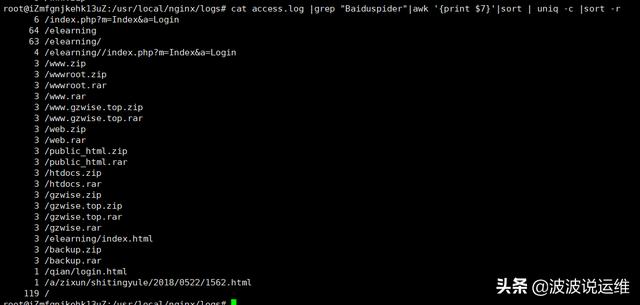

5、百度蜘蛛爬行页面按次数降序列表

# cat access.log |grep "Baiduspider"|awk '{print $7}'|sort | uniq -c |sort -r

篇幅有限,关于nginx去查看搜索引擎蜘蛛爬虫的行为的内容就介绍到这了,上面的一些命令都是比较常用的,后面会分享更多关于nginx方面内容,感兴趣的朋友可以关注下!

关键字:

上一篇:详解数据库设计基础:三大范式

下一篇:如何在面试中介绍自己的项目经验